Achtergrond

Nieuw AI-model brengt IT-beveiliging in gevaar en verhoogt deze tegelijkertijd

van David Lee

Kunstmatige intelligentie belooft details in medische beelden te herkennen die voor het menselijk oog verborgen blijven. Een nieuw onderzoek laat echter zien hoe gemakkelijk AI-modellen misleidende patronen in de gegevens kunnen vinden en tot verkeerde conclusies kunnen komen.

Stel je voor dat een computerprogramma op basis van een röntgenfoto van je knie kan voorspellen of je wel of niet graag bier drinkt. Klinkt dat absurd? Dat is precies wat onderzoekers hebben bereikt in een recente studie. Er was echter geen vreugde over het vermeende succes - in plaats daarvan is de publicatie bedoeld om de aandacht te vestigen op een serieus probleem in de ontwikkeling van kunstmatige intelligentie voor medische beeldvorming.

In hun paper gepubliceerd in Scientific Reports laten de auteurs zien hoe vatbaar deep learning algoritmen zijn voor zogeheten shortcutting. Dit is een fenomeen waarbij AI-modellen praktisch shortcuts nemen. Ze vertrouwen op oppervlakkige patronen in de trainingsgegevens in plaats van de werkelijk relevante medische kenmerken te leren.

Shortcutting treedt op wanneer een model een eenvoudige oplossing voor een taak vindt zonder het onderliggende probleem echt te begrijpen. In een medische context kan dit bijzonder problematisch zijn.

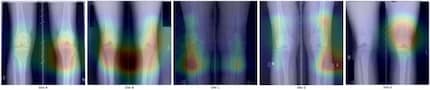

Om het probleem te illustreren, trainden de onderzoekers eenvoudige neurale netwerken om te voorspellen of patiënten bier of gebakken bonen vermijden op basis van röntgenfoto's van de knie. Omdat deze voorkeuren niet logisch te herkennen zijn op een röntgenfoto van de knie, zou de AI geen overeenkomstige uitspraken moeten kunnen doen. Het resultaat zou echter als een verrassing moeten komen: De AI-modellen waren in staat om de voorkeuren te voorspellen met een nauwkeurigheid van 63 procent voor bonen en zelfs 73 procent voor bier. Aanzienlijk meer dan wanneer het gewoon geraden had. Dit ondanks het feit dat er geen plausibel medisch verband is tussen deze eetgewoonten en het uiterlijk van een knie.

Hoe zijn de modellen tot zulke resultaten gekomen? Het antwoord ligt in verborgen correlaties binnen de datasets. De AI-systemen leerden subtiele patronen herkennen die te maken hadden met demografische factoren of technische details van de beeldopname. Met andere woorden, ze baseerden hun voorspellingen niet op het uiterlijk van de röntgenfoto's, maar eerder op de leeftijd en het geslacht van de patiënten, hun etniciteit of waar ze woonden. Ze waren bijvoorbeeld in staat om het klinische centrum te identificeren waar de foto was genomen of zelfs het bouwjaar van het röntgenapparaat te bepalen.

"Deze resultaten laten zien hoe gemakkelijk het is om modellen te maken met verrassend nauwkeurige voorspellingen die elke plausibiliteit missen," waarschuwen de auteurs van het onderzoek. In medisch onderzoek zou dit tot verkeerde conclusies kunnen leiden. Als je denkt dat een AI-model een baanbrekende nieuwe ontdekking heeft gedaan, kan het eigenlijk gewoon een willekeurige correlatie in de gegevens hebben gevonden.

Het probleem van het kortsluiten gaat veel verder dan eenvoudige vertekening. Het onderzoek laat zien dat de modellen niet alleen gebruik maken van individuele verstorende factoren zoals geslacht of leeftijd, maar ook van complexe combinaties van verschillende variabelen. Zelfs als voor de hand liggende beïnvloedende factoren worden uitgesloten, vinden de algoritmes vaak andere manieren om hun voorspellingen te doen.

Wetenschapsredacteur en bioloog. Ik hou van dieren en ben gefascineerd door planten, hun mogelijkheden en alles wat je ermee kunt doen. Daarom is mijn favoriete plek altijd buiten - ergens in de natuur, het liefst in mijn wilde tuin.

Interessante feiten uit de wereld van producten, een kijkje achter de schermen van fabrikanten en portretten van interessante mensen.

Alles tonen